Blog

Rischio terze parti per quanto riguarda l'intelligenza artificiale

Al fine di integrare i sistemi di intelligenza artificiale nelle loro attività, le aziende si affidano sempre più spesso a vendor di terze parti. Scopri come adattare i tuoi processi di gestione deil rischio terze parti per affrontare i rischi correlati all'intelligenza artificiale

Sebbene l'intelligenza artificiale stia diventando la colonna portante delle operazioni aziendali moderne per molte organizzazioni, poche di queste creano i sistemi stessi. Il più delle volte le organizzazioni si affidano a vendor di terze parti per integrare soluzioni di intelligenza artificiale nelle loro operazioni quotidiane.

Questo passaggio a soluzioni esterne rende necessaria una trasformazione fondamentale nel modo in cui le aziende valutano e gestiscono i rischi associati all'utilizzo dell'intelligenza artificiale.

In questo articolo scopriremo perché adottare un approccio globale alle valutazioni dei vendor è così importante e spiegheremo come la governance dell'intelligenza artificiale può svolgere un ruolo fondamentale nella mitigazione dei rischi e nella promozione di pratiche responsabili.

Cambiamenti epocali nelle valutazioni dei vendor

La maggior parte delle aziende utilizza strategie di gestione dei rischi di terzi (Third-party Risk Management, TPRM) per gestire i vendor di terze parti. Tuttavia, questi flussi di lavoro tradizionali devono evolversi per tenere il passo con l'integrazione dinamica dell'intelligenza artificiale.

Abbiamo notato che l'approccio isolato agli aspetti più tradizionali dei rischi terze parti, come ad esempio la privacy, la sicurezza, l'etica, la continuità operativa, la resilienza, ecc. non giova più alle aziende. Questo vale anche per l'adozione dell'intelligenza artificiale da parte di terzi. Infatti, tutto ciò sottolinea la necessità per le organizzazioni di ridefinire il proprio approccio alla valutazione dei fornitori in modo che sia più globale e includa l'utilizzo dell'intelligenza artificiale.

Il contesto tecnico: valutazione dei sistemi e dei componenti di intelligenza artificiale

Comprendere le complessità tecniche dei sistemi di intelligenza artificiale implementati dai vendor è alla base di una solida valutazione. L'analisi di questo tipo di tecnologia rivela potenziali rischi associati ai componenti di intelligenza artificiale in soluzioni di terze parti, inclusi i seguenti aspetti.

- Attributi dei set di dati

I sistemi di intelligenza artificiale richiedono un'abbondanza di dati e una chiara comprensione degli attributi di questi set di dati. Le valutazioni devono aiutarti a comprendere la qualità dei dati, le loro fonti di formazione, proprietà, controllo delle versioni, tracciabilità, ecc.

- Attributi dei modelli

Una volta ottenuta la trasparenza sui set di dati che intendi utilizzare, devi raggiungere un livello analogo di chiarezza sul modello stesso. Il modello che stai utilizzando è un modello di base? Quale metodo di apprendimento utilizza? Quali pregiudizi possono essere presenti e qual è il rapporto di parità demografica? Qual è il livello di autonomia del modello e quanta supervisione umana è necessaria?

Questo contesto tecnico per gli attributi di set di dati e modelli costituisce il primo livello di una valutazione completa dei sistemi di intelligenza artificiale di terze parti.

Anche se non sviluppi o distribuisci autonomamente il sistema, in qualità di distributore di un sistema di intelligenza artificiale di terze parti hai comunque obblighi e responsabilità sui dati e sui modelli che utilizzi. Pertanto, è importante che le risposte a queste domande siano ben ponderate.

Quadri di riferimento della governance dell'intelligenza artificiale: come affrontare la conformità e i requisiti

Le pratiche di governance dell'intelligenza artificiale sono una componente critica dell'utilizzo responsabile di questo tipo di tecnologia, non solo delle tue pratiche interne. È sempre più importante valutare anche il quadro di governance dell'intelligenza artificiale del tuo vendor: in questo modo otterrai maggiori informazioni sulla conformità e sugli aspetti legali ed etici delle sue pratiche.

I quadri normativi internazionali come la legge sull'intelligenza artificiale dell'Unione europea stanno introducendo sempre più requisiti specifici sugli attori responsabili, a seconda del loro ruolo, come le valutazioni di conformità per i fornitori di sistemi di intelligenza artificiale ad alto rischio.

Sebbene le aziende che utilizzano l'intelligenza artificiale di terze parti non rientrino in questa categoria di vendor, le organizzazioni devono comunque essere consapevoli delle loro responsabilità in quanto fornitori di questi sistemi e devono allinearsi ai quadri normativi in vigore per garantire la conformità e le pratiche di utilizzo responsabile da parte dei loro fornitori.

Approccio globale alle valutazioni

I vantaggi di una valutazione globale vanno oltre la semplice conformità. Evitare le insidie legali ed etiche associate ai sistemi di intelligenza artificiale utilizzati da terzi è fondamentale per costruire rapporti basati sulla fiducia e mantenere la trasparenza nell'ecosistema del vendor.

Dover valutare i fornitori oltre alle proprie responsabilità di governance dell'intelligenza artificiale può sembrare un impegno enorme, ma non deve esserlo per forza. L'operatività delle valutazioni di governance dell'intelligenza artificiale comporta passaggi pratici e più piccoli, come l'integrazione della governance dell'IA nei flussi di lavoro di gestione del rischio terze parti già esistenti.

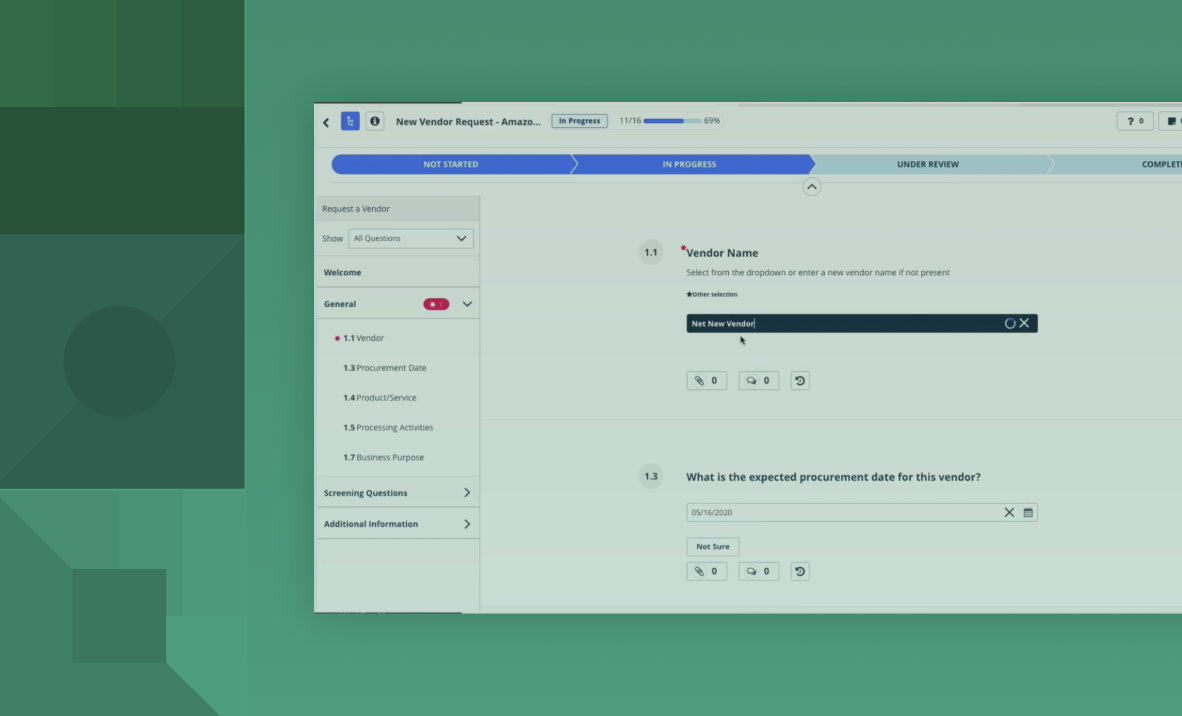

Strumenti come le soluzioni AI Governance e Third-Party Risk Management di OneTrust supportano le aziende nell'ottimizzazione di questo processo, il che garantisce una visione più completa delle iniziative relative all'implementazione di componenti di intelligenza artificiale in tutta l'azienda.

Gestione del rischio terze parti per costruire rapporti di fiducia

Poiché il panorama dei rischi legati all'intelligenza artificiale di terze parti continua ad evolversi, le organizzazioni devono adottare un approccio globale alla valutazione dei fornitori.

Incorporare i rischi legati all'intelligenza artificiale in queste valutazioni è una vera e propria esigenza dal punto di vista strategico. Inoltre, costituisce anche un passo dinamico verso pratiche di gestione di rischi terze parti e un utilizzo dell'intelligenza artificiale più responsabili.

La creazione di un quadro di riferimento completo non solo supporta la mitigazione dei rischi associati all'adozione dell'intelligenza artificiale da parte di terzi, ma promuove anche un ecosistema basato su trasparenza, fiducia e innovazione.

Per garantire un futuro in cui l'intelligenza artificiale sia utilizzata in modo responsabile per una crescita aziendale sostenibile, le organizzazioni devono adattare i loro flussi di lavoro relativi alla gestione del rischio terze parti per affrontare le complessità di questa tecnologia.

Altre risorse che potrebbero interessarti

eBook

Rischio terze parti

Conformità della privacy dei dati e gestione delle terze parti: un approccio unificato

Comprendere l'importanza della privacy dei dati nella gestione del rischio terze parti e le dieci pratiche consigliate per garantire la conformità quando si lavora con terze parti.

ottobre 29, 2025

Report

Technology Risk & Compliance

OneTrust è stata nominata leader nell'IDC MarketScape for Worldwide Software GRC Software Report 2025

La piattaforma OneTrust collega i team che si occupano di dati, privacy e rischio in un unico sistema in modo da poter stare al passo con i cambiamenti normativi e supportare una crescita responsabile. Scarica l'estratto per scoprire come OneTrust può aiutarti a velocizzare le tue operazioni senza sacrificare la conformità

settembre 03, 2025

Webinar in programma

Rischio terze parti

OneTrust con OneTrust: gestione di terze parti e vendor

L'approccio del nostro Responsabile della sicurezza informatica (Chief Information Security Officer, CISO) per valutare e mitigare il rischio terze parti utilizzando la nostra piattaforma.

luglio 16, 2025

eBook

Rischio terze parti

Guida completa alla gestione del rischio terze parti

L'implementazione di un approccio globale alla gestione delle terze parti è essenziale per i team che si occupano di sicurezza.

maggio 21, 2025

eBook

Rischio terze parti

Ciclo di vita della gestione del rischio terze parti

Scarica il nostro eBook sulla gestione del rischio terze parti e ottieni un piano d'azione per il ciclo di vita del programma.

maggio 21, 2025

Webinar in programma

Rischio terze parti

Live Demo: Costruire un solido programma di gestione del rischio terze parti con OneTrust

Partecipa al nostro webinar per scoprire come la soluzione TPRM di OneTrust può rivoluzionare il tuo approccio alla gestione del rischio terze parti.

marzo 27, 2025

Webinar in programma

Rischio terze parti

DORA in Azione: Garantire la Compliance e il Successo con OneTrust

Partecipa al nostro webinar sul Digital Operational Resilience Act (DORA), ora attivo da oltre un mese.

marzo 06, 2025

eBook

Rischio terze parti

Utilizzare la gestione delle terze parti per orientarsi nel panorama del rischio in diversi settori

Scarica questo eBook per esplorare la gestione delle terze parti in diversi settori e scoprire le considerazioni più importanti prima di implementare questo approccio nella tua organizzazione.

febbraio 21, 2025

Lista di controllo

Rischio terze parti

6 passaggi per un'efficace gestione del rischio terze parti

Scopri il percorso relativo alla gestione efficace dei rischi terze parti grazie a una lista di controllo che delinea le sei fasi di un solido programma TPRM.

febbraio 12, 2025

Lista di controllo

Rischio terze parti

Hai tutto pronto per conformati al DORA?

Il regolamento sulla resilienza operativa digitale (Digital Operational Resilience Act, DORA) è il primo regolamento redatto per supervisionare la sicurezza delle entità finanziarie in tutta l'Unione europea.

febbraio 12, 2025

Report

OneTrust è stata nominata leader nel report "Operational Resilience Software 2024"

Scarica il report di Verdantix per scoprire l'importanza della resilienza operativa per la tua azienda e perché OneTrust è stata nominata leader nel settore.

gennaio 28, 2025

eBook

Rischio terze parti

Semplifica la gestione del rischio terze parti

Semplifica le relazioni con le terze parti ed evita errori comuni.

gennaio 22, 2025

Report

Privacy Automation

Una nuova direzione per i dati

Se da un lato l'intelligenza artificiale continua a offrire opportunità impareggiabili per l'innovazione aziendale, dall'altro presenta anche rischi che le organizzazioni devono affrontare con decisione attraverso programmi di governance scalabili che abbraccino più origini dati. Sei tendenze principali stanno determinando queste sfide.

gennaio 22, 2025

GRC e garanzia di sicurezza

Navigare la conformità al NIS2 con OneTrust

Partecipa al nostro webinar per approfondire i principali requisiti della Direttiva NIS2 e il suo impatto sul territorio italiano.

ottobre 24, 2024

Webinar in programma

GRC e garanzia di sicurezza

Come migliorare l’efficienza nella gestione delle terze parti: dalla due diligence alla gestione del rischio

Unisciti a noi per questo webinar, in collaborazione con Syscons, il 16 aprile alle 11:00, per ascoltare le migliori pratiche e strategie vincenti per affrontare al meglio i rischi derivanti da terze parti e raggiungere una gestione più efficace ed efficiente.

aprile 16, 2024

Demo

Rischio terze parti

Demo di OneTrust Third-Party Management

Scopri in che modo la soluzione Third-Party Management può aiutarti a valutare, monitorare e mitigare i rischi correlati ai vendor, garantendo allo stesso tempo la conformità.