Blog

Informazioni sulle valutazioni di conformità ai sensi del regolamento sull'intelligenza artificiale dell'Unione europea

Cosa sono le valutazioni di conformità? Chi ne è responsabile e perché sono importanti? Scopri di più su queste valutazioni e su come si relazionano al tuo programma di governance di intelligenza artificiale

Lauren Diethelm

Specialista di marketing dei contenuti IA

20 novembre 2023

La bozza del regolamento sull'intelligenza artificiale dell'Unione europea adotta un approccio basato sulle precauzioni e sui rischi correlati all'IA. A tal fine, sono state identificate quattro diverse categorie di rischio in cui i sistemi di intelligenza artificiale possono essere classificati. Queste categorie sono progettate per proteggere la salute, la sicurezza e i diritti fondamentali delle persone che entrano in contatto con questi tipi di sistemi.

I sistemi ad alto rischio possono essere utilizzati, ma devono soddisfare un maggior numero di requisiti prima di poter essere distribuiti al pubblico: uno di questi è la valutazione di conformità (Conformity Assessment, CA).

Fai clic qui per scaricare la guida sviluppata in collaborazione con Future of Privacy Forum.

Che cos'è una valutazione di conformità?

L'articolo 3 della bozza del regolamento sull'intelligenza artificiale definisce le valutazioni di conformità come il processo di verifica e/o dimostrazione della conformità di un sistema ad alto rischio a determinati requisiti stabiliti dal regolamento stesso. I requisiti sono i seguenti:

- sistema di gestione dei rischi;

- governance dei dati;

- documentazione tecnica;

- conservazione delle registrazioni;

- trasparenza e fornitura di informazioni;

- supervisione umana;

- precisione, robustezza e sicurezza informatica.

I provider di sistemi di intelligenza artificiale ad alto rischio devono soddisfare questi requisiti prima che il loro sistema possa essere immesso sul mercato, il che protegge il pubblico da potenziali danni. Le valutazioni di conformità sono strumenti fondamentali quando si tratta di responsabilizzazione dei sistemi ad alto rischio: pertanto, capire come e dove funzionano è altrettanto importante per il tuo programma di governance.

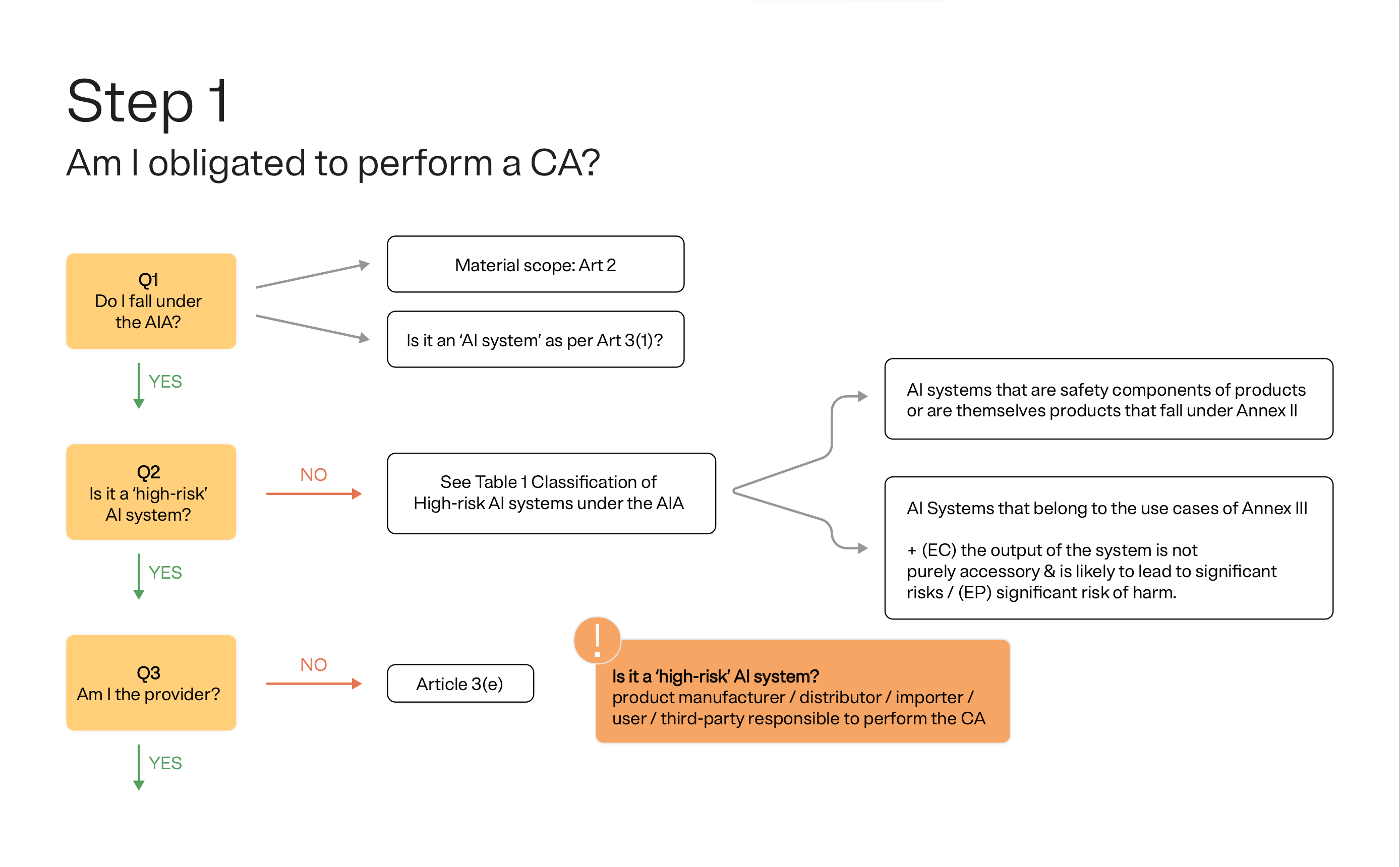

Devo effettuare una valutazione di conformità?

La necessità di eseguire o meno una valutazione di conformità dipende da alcuni fattori. Continua a leggere per determinare se effettivamente devi condurre una valutazione di conformità.

Prima di tutto, rientri nella giurisdizione del regolamento sull'intelligenza artificiale dell'Unione europea? In più, il sistema che desideri utilizzare è effettivamente considerato un sistema di intelligenza artificiale ai sensi dell'articolo 3, punto 1 del regolamento? In caso contrario, non devi condurre nessuna valutazione di conformità. Lo stesso vale se il sistema non è considerato un sistema ad alto rischio dal regolamento sull'intelligenza artificiale dell'Unione europea. Infatti, solo questo tipo di sistemi sono tenuti a superare una valutazione di conformità.

L'altro fattore determinante è il tuo ruolo nel sistema. Se sei il provider del sistema o un soggetto responsabile, devi effettuare una valutazione di conformità. Di solito il provider e il soggetto responsabile coincidono, ma esistono alcune eccezioni in cui il soggetto responsabile è qualcun altro.

I soggetti responsabili possono essere un distributore, un importatore, un deployer o qualsiasi altra terza parte che utilizza l'intelligenza artificiale con il proprio nome o marchio. I requisiti legali esatti per stabilire se o quando un soggetto diverso dal provider debba eseguire la valutazione di conformità non sono ancora stati stabiliti.

Quando dovrei effettuare una valutazione di conformità?

Una volta stabilita la necessità di una valutazione di conformità, devi decidere quando effettuarla. Di seguito è riportata la tempistica in cui devono essere eseguite le valutazioni di conformità.

- A priori: la valutazione di conformità deve essere condotta prima che il sistema di intelligenza artificiale venga immesso sul mercato europeo, ovvero prima di renderlo disponibile al pubblico.

- A posteriori: dopo l'immissione sul mercato di un sistema ad alto rischio, è necessaria una nuova valutazione di conformità se il sistema subisce modifiche significative. Vale la pena notare che questo non significa che il sistema continuerà ad apprendere anche dopo essere stato immesso sul mercato, come succede per i modelli. Si riferisce piuttosto a qualsiasi modifica che influisca significativamente sulla conformità del sistema ai requisiti misurati dalla valutazione.

Chi conduce le valutazioni di conformità?

Le valutazioni di conformità possono essere condotte in due modi: internamente o mediante terze parti. Come suggeriscono i nomi, le valutazioni di conformità interne sono condotte dal provider o dal soggetto responsabile, mentre quelle di terze parti sono condotte da un ''organismo notificato'' esterno.

L'articolo 43 del regolamento sull'intelligenza artificiale stabilisce una guida più esplicita su quali casi richiedono una valutazione di conformità interna e quali devono essere sottoposti a un processo di terze parti. Consulta questa guida dettagliata per ottenere maggiori informazioni per ciascun processo.

Conformità ai requisiti per i sistemi ad alto rischio

Come accennato in precedenza, le valutazioni di conformità mirano a verificare che i sistemi ad alto rischio rispettino tutti e sette i requisiti, ovvero gestione dei rischi, governance dei dati, documentazione tecnica, conservazione delle registrazioni, obblighi di trasparenza, supervisione umana e accuratezza, robustezza e sicurezza informatica, stabiliti dal regolamento sull'intelligenza artificiale.

Se non diversamente specificato, tutti questi requisiti devono essere soddisfatti prima che il sistema di intelligenza artificiale venga messo in servizio o immesso sul mercato. Inoltre, una volta che il sistema è in uso, il provider ne deve garantire la conformità per tutto il ciclo di vita.

Nel valutare questi requisiti, devi tenere conto dell'uso previsto del sistema e di qualsiasi uso improprio ragionevolmente prevedibile.

Utilizza questa guida per approfondire ciascuno dei diversi requisiti e per vedere come conformarti e implementarli.

Altre risorse che potrebbero interessarti

White Paper

AI Governance

Rendi operativa la legge dell'UE sull'IA con OneTrust: guida all'implementazione

maggio 13, 2025

Report

Uso responsabile dell'intelligenza artificiale

Report di Gartner® ''Getting Ready for the EU AI Act, Phase 1: Discover & Catalog''

Report di Gartner® ''Getting Ready for the EU AI Act, Phase 1: Discover & Catalog''

gennaio 23, 2025

White Paper

AI Governance

Playbook sull'intelligenza artificiale

Una guida pratica per fornitore e deployer dell'intelligenza artificiale